关于 AI 安全

我觉得安全问题对未来 AI 的发展至关重要。之前跟一个人就这个话题争了很久。他觉得现在的 AI 系统还不够强,构不成什么威胁;但我的看法是,我们应该防患于未然,为未来可能出现的任何情况做好准备。说实话,以前看《终结者》的时候,我也不信那种"灾难性后果"的剧情。但到了今天,看着 AI 发展得这么猛,我确实会担心一些不好的东西会随之而来。

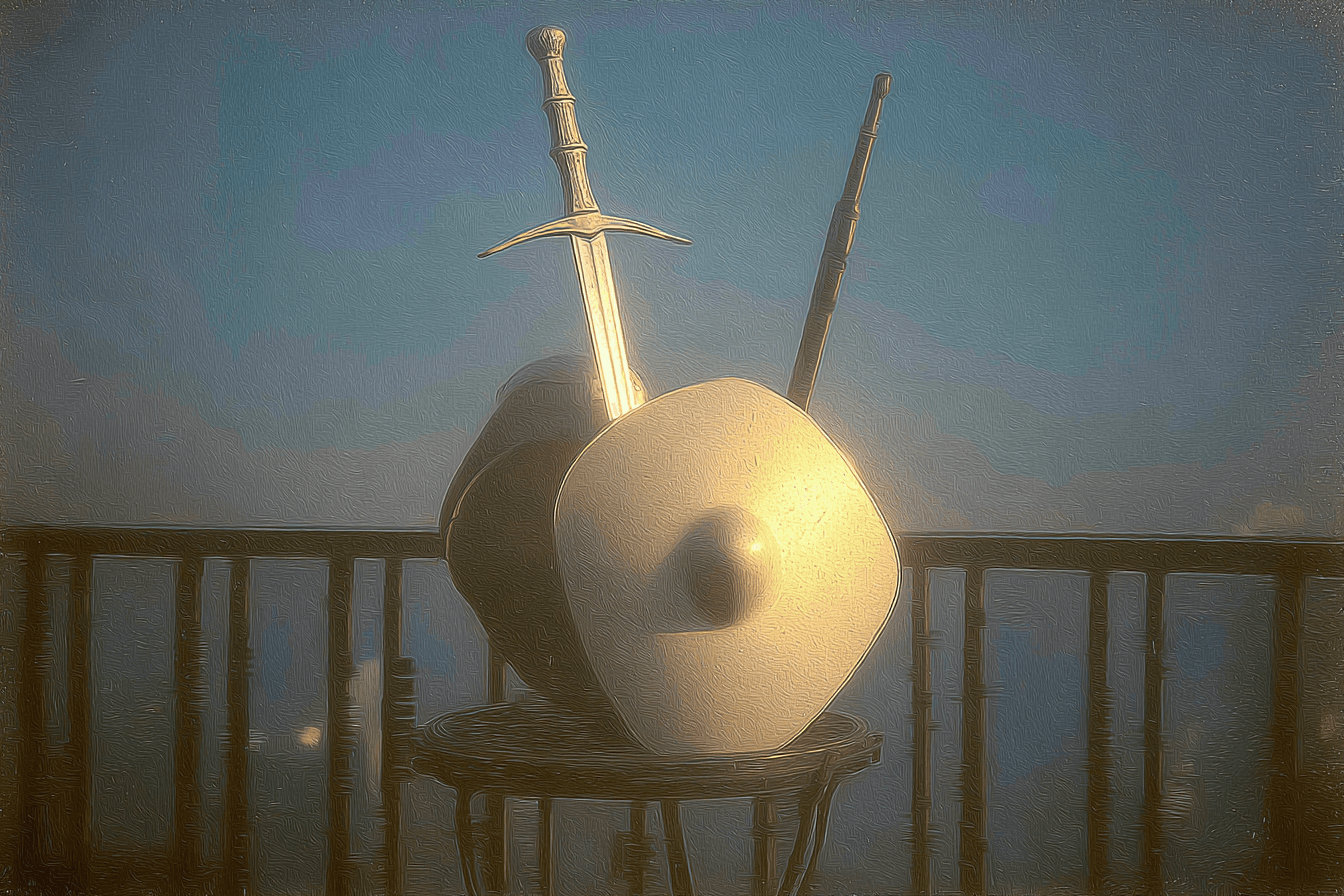

我真的相信 alignment、安全方面的后训练,这些就是人类的生命线。它们为模型的能力设了边界,把里面那头"怪兽"关进了笼子——我们可以安全地在外面研究它,不用担心被伤害。但这不代表我反对 AI 的发展。恰恰相反,我觉得现在的模型都很棒——gpt-4o、claude-3-opus,还有即将推出的 llama-3-400b,都相当给力。我只是希望它们在变强的同时也能更安全,在能力和安全之间找到完美的平衡。OpenAI 刚宣布要成立新的安全委员会,但愿它真能发挥作用 ;)

顺便说一句,我是真的很喜欢 Anthropic。喜欢他们的模型,喜欢他们的研究,尤其是最近那篇关于模型可解释性的。能够"激活"模型内部的特定特征,这真的为探索模型能力开辟了一条全新的路。第一次读到那篇博客的时候,我是真的惊了。

关于 AGI

这是一个挺抽象的概念。"通用"到底要多"通用"?连 Anthropic 的 ASL 分级都有点说不清楚。在我看来,实现 AGI 并不需要一个在所有领域都碾压人类的系统——只要在大多数领域超过人类平均水平就够了。不过在那之前,我觉得有个前提:AI 系统得能真正理解以下这些东西——

- 谜语

- 笑话

- 梗图 / Memes

- 成语和习语

- 跟特定文化背景相关的内容

这些看起来好像不太重要,但恰恰能反映模型最核心的语言能力。说到底,LLM 就是一个预测下一个词的系统。如果它不能真正理解词语背后的规律,上面那些东西它就搞不定。反过来说,如果一个模型在预测下一个词上足够强,或者说它真正摸透了文字之间的那些隐秘关联,那它整体上大概率也会非常强大。(这个想法是我从 Ilya 的一期播客里学到的 hahaha)

但话说回来,如果 AI 真的在所有领域——不只是平均水平,而是全部——都超越了人类呢?我们会被取代吗?没人知道,只有时间能给出答案。我们能做的就是尽可能地做好准备,确保未来的前沿发展能达到一种平衡。

希望 AGI 未来真的能造福人类。