To scale, or not to scale? 挺有意思的话题。Scaling Laws 是 AI 和机器学习领域一条很有名的定律,业界对此看法各异。所以我想聊聊自己对算力扩展的一些想法,这也是 Scaling Laws 中很核心的一部分。

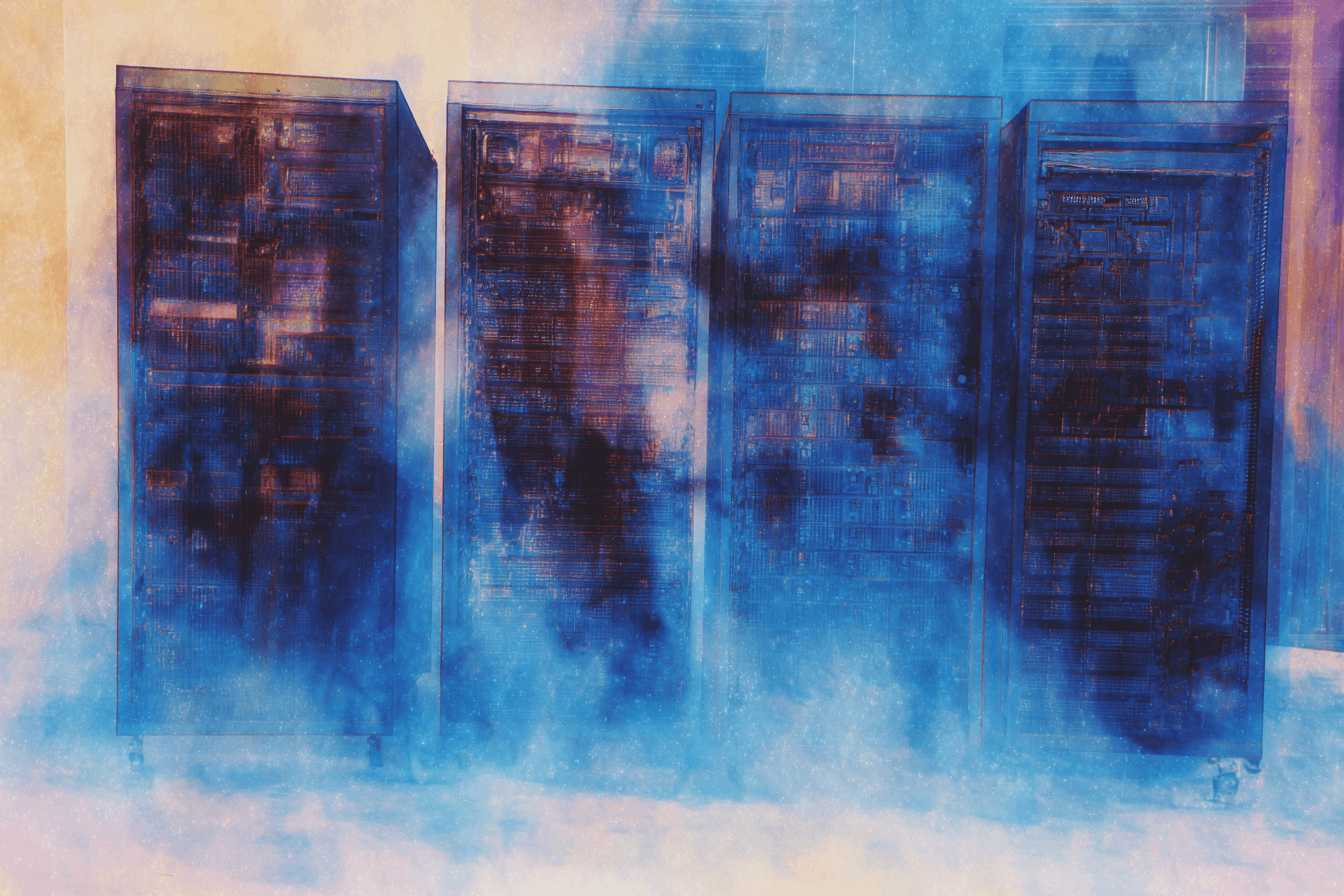

我认为 LLM 训练在算力层面仍有很大的上升空间。这需要资金和资源两手一起抓,目前的趋势看起来还不错。虽然得警惕算力竞赛沦为公司之间的军备竞赛,但我觉得竞争恰恰是当下需要的。关键在于把重心放在训练效率上,别走向回形针效应。否则就算把全人类的资源砸进去,也看不到什么像样的成果,反而会对全球生态造成灾难性影响——跟"构建一个造福全人类的 AGI"这个初衷完全背道而驰。说实话,即便效率很高,模型训练的成本依然惊人。几个月前微软和 OpenAI 宣布要投 1000 亿美元建大规模算力中心。上个月的采访里,Anthropic CEO Dario 也说了,目前的投入够训练下一代模型,但明年的情况他自己也没把握,预测训练成本可能到几百亿甚至上千亿美元。

可能有人会说,与其一门心思堆算力,不如去研究更高效的模型架构。但我觉得你得确保短期内的研究路线有足够的潜力和可行性。否则对大厂来说就是在赌——而他们赌不起。一旦掉队,想追就太难了。现在就看谁能在这场持久战中笑到最后。